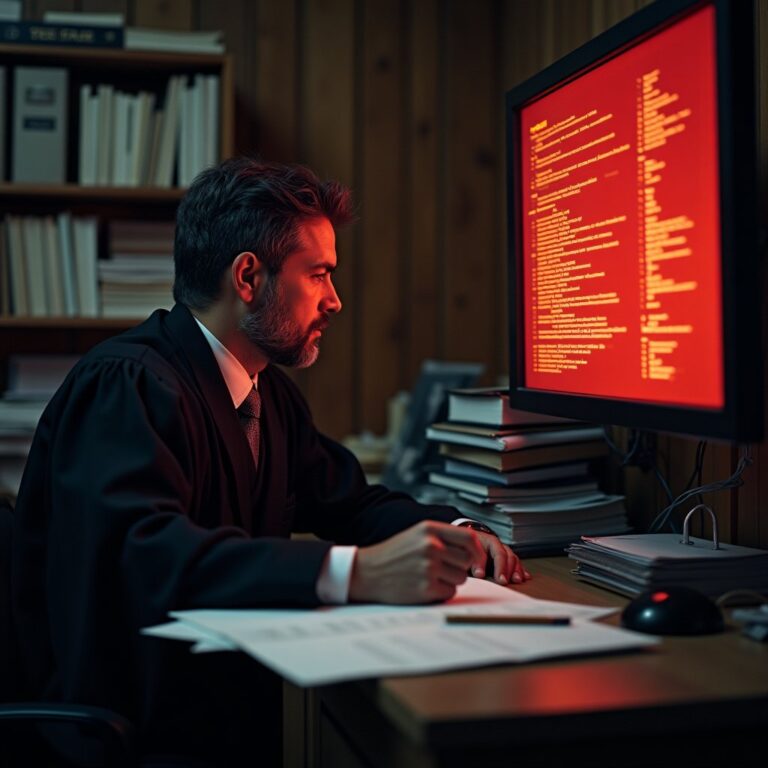

Justice indienne : 40 décisions juridiques annulées pour usage abusif de l’IA

Actuellement, le système judiciaire indien affronte une crise sans précédent dans l’administration de la justice numérique. Quarante jugements et décisions ont dû être annulés ou révisés après la révélation de leur élaboration par des intelligences artificielles défaillantes, remettant en cause les processus d’automatisation judiciaire.

Les faits sont accablants : à Delhi, un jugement contenait des références légales inexistantes. À Bombay, sept mémoires d’avocats présentaient des citations inventées. À Madras, quinze décisions judiciaires comportaient des erreurs factuelles et juridiques graves. Au total, huit tribunaux sont concernés par ces dysfonctionnements majeurs dans l’application de l’IA juridique.

Les études révèlent l’ampleur du problème dans la justice prédictive : 37% des décisions générées par IA contiennent des erreurs, 22% des citations sont inventées. Pire encore, 60% des outils utilisés n’avaient aucun système de vérification humaine, compromettant la fiabilité des algorithmes judiciaires.

Face à cette situation critique, la Cour suprême indienne a suspendu temporairement l’usage de l’IA dans les décisions finales. Un projet de loi est en cours pour imposer la certification des outils et créer un registre national des décisions assistées par IA, établissant un cadre réglementaire essentiel.

La confiance dans le système judiciaire est en jeu. L’urgence est réelle : chaque erreur judiciaire générée par une IA représente une vie bouleversée, une injustice commise. Les autorités judiciaires doivent maintenant trouver l’équilibre entre innovation technologique et protection des droits fondamentaux dans cette transformation numérique du système judiciaire.